Homepage

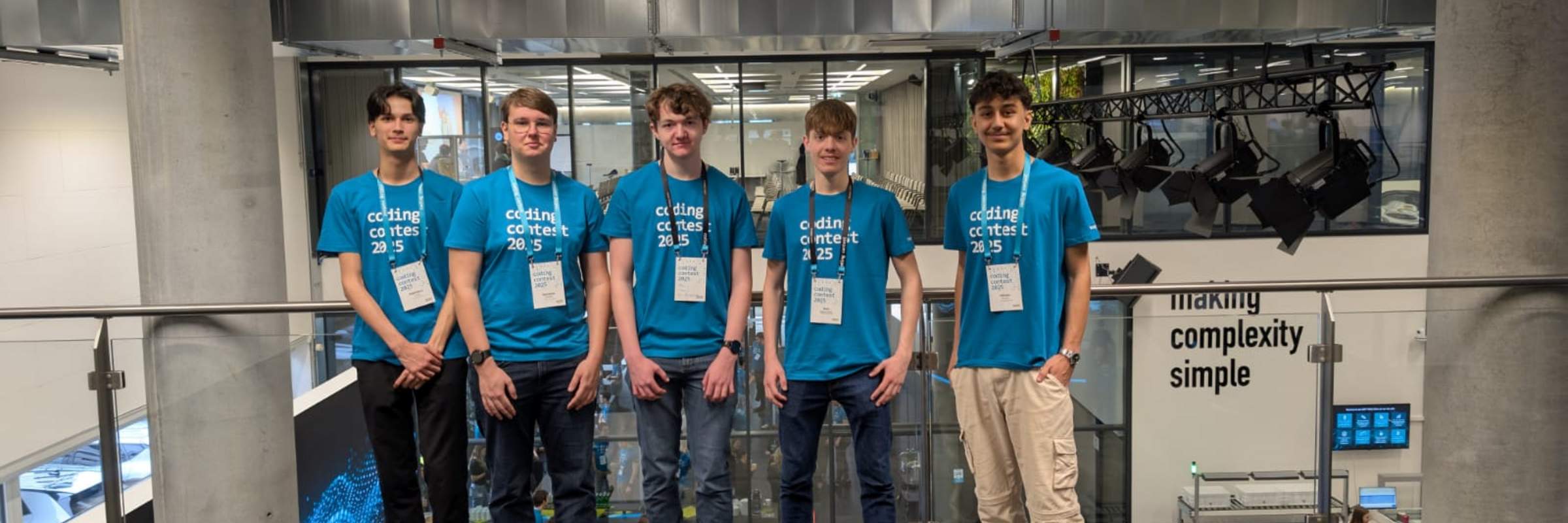

Wie schon fast eine Tradition an der HTL Mössingerstraße, durften wir auch heuer wieder mit sogar drei Teams – als einzige HTL aus Kärnten – am…

mehr

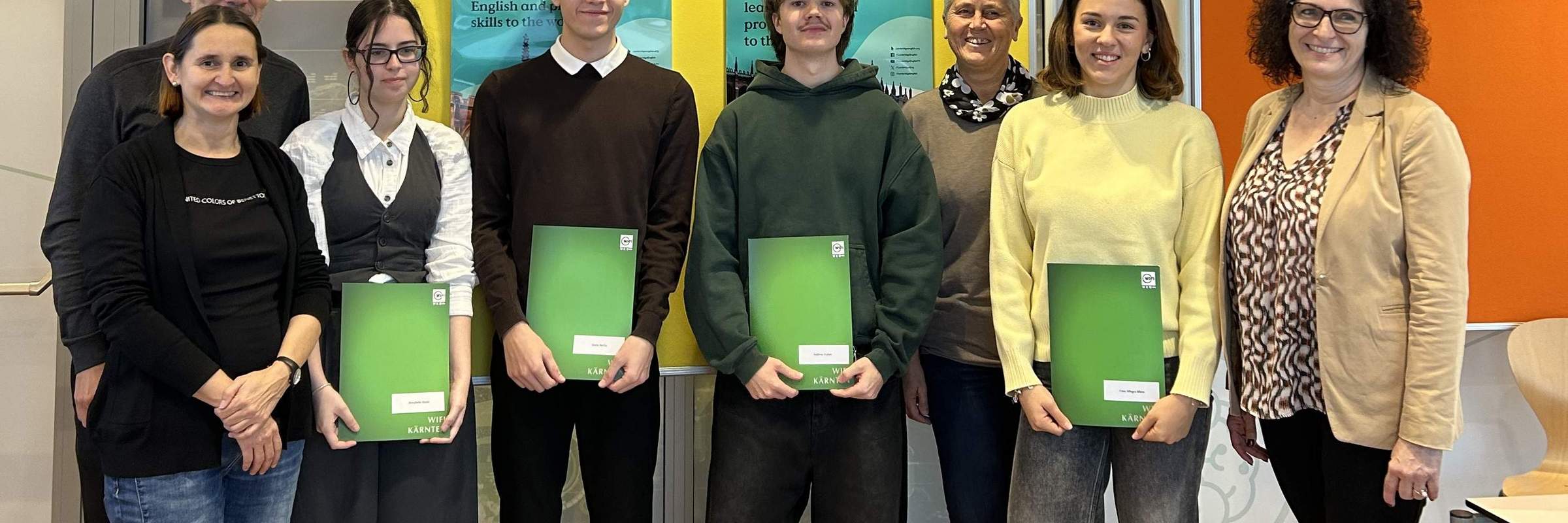

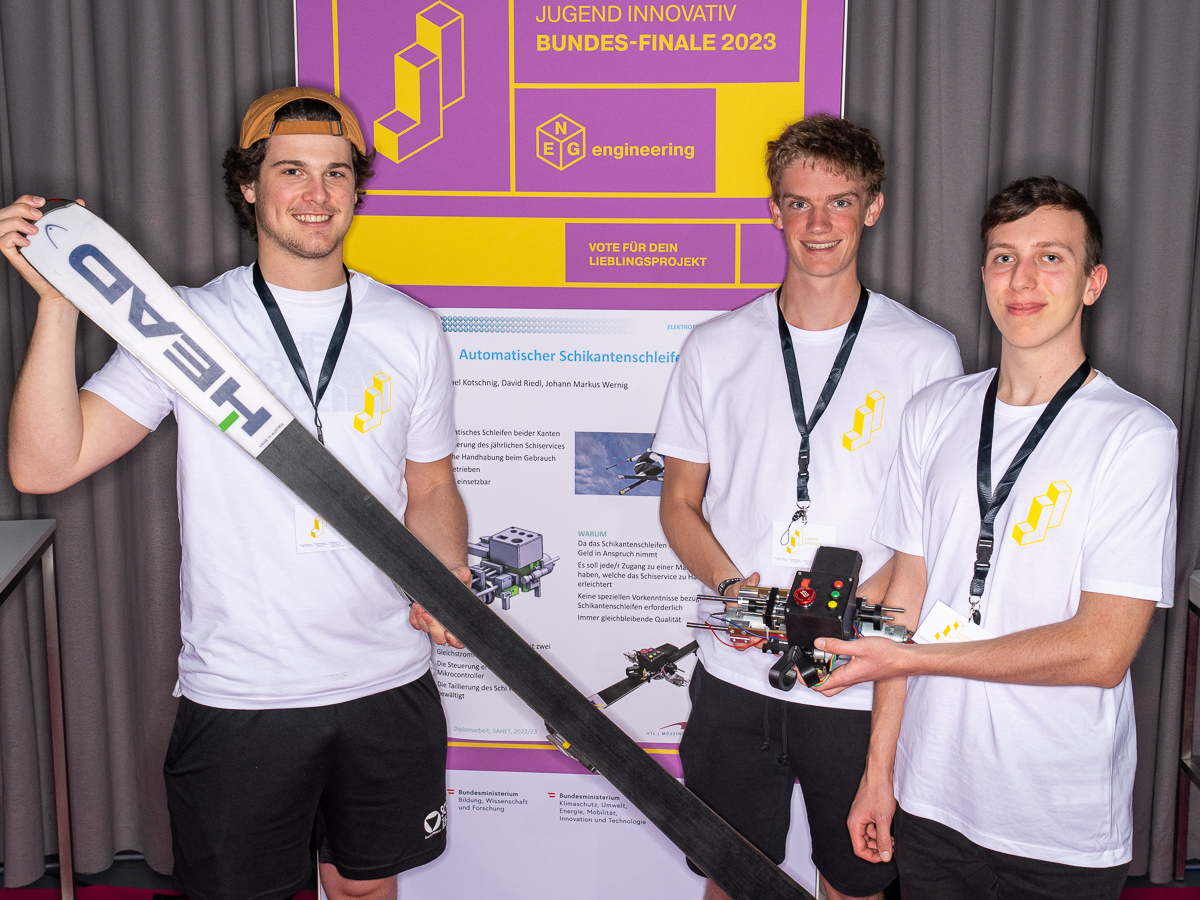

Vom 23. – 25. Mai 2023 fand in Wien das Finale des 36. Schulwettbewerbs „Jugend Innovativ“ statt, welcher von den Trägerministerien BM für Arbeit und Wirtschaft, BM für Bildung, Wissenschaft und Forschung und dem BM für Klimaschutz, Umwelt, Energie, Mobilität, Innovation und Technologie gefördert wird.

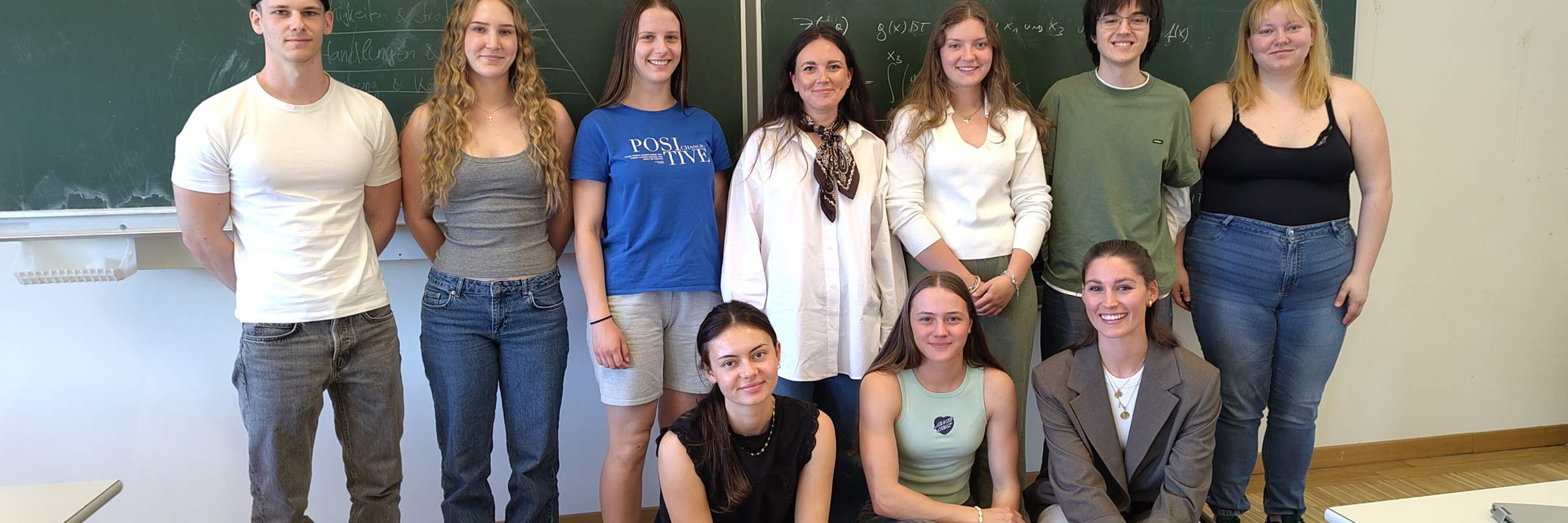

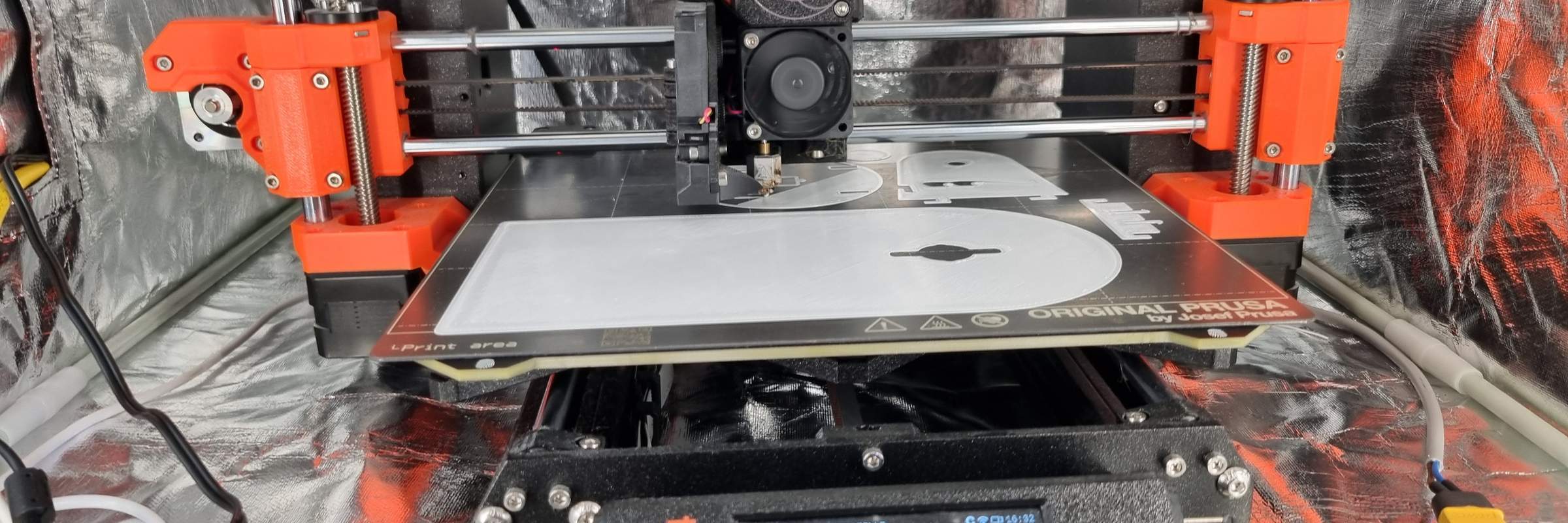

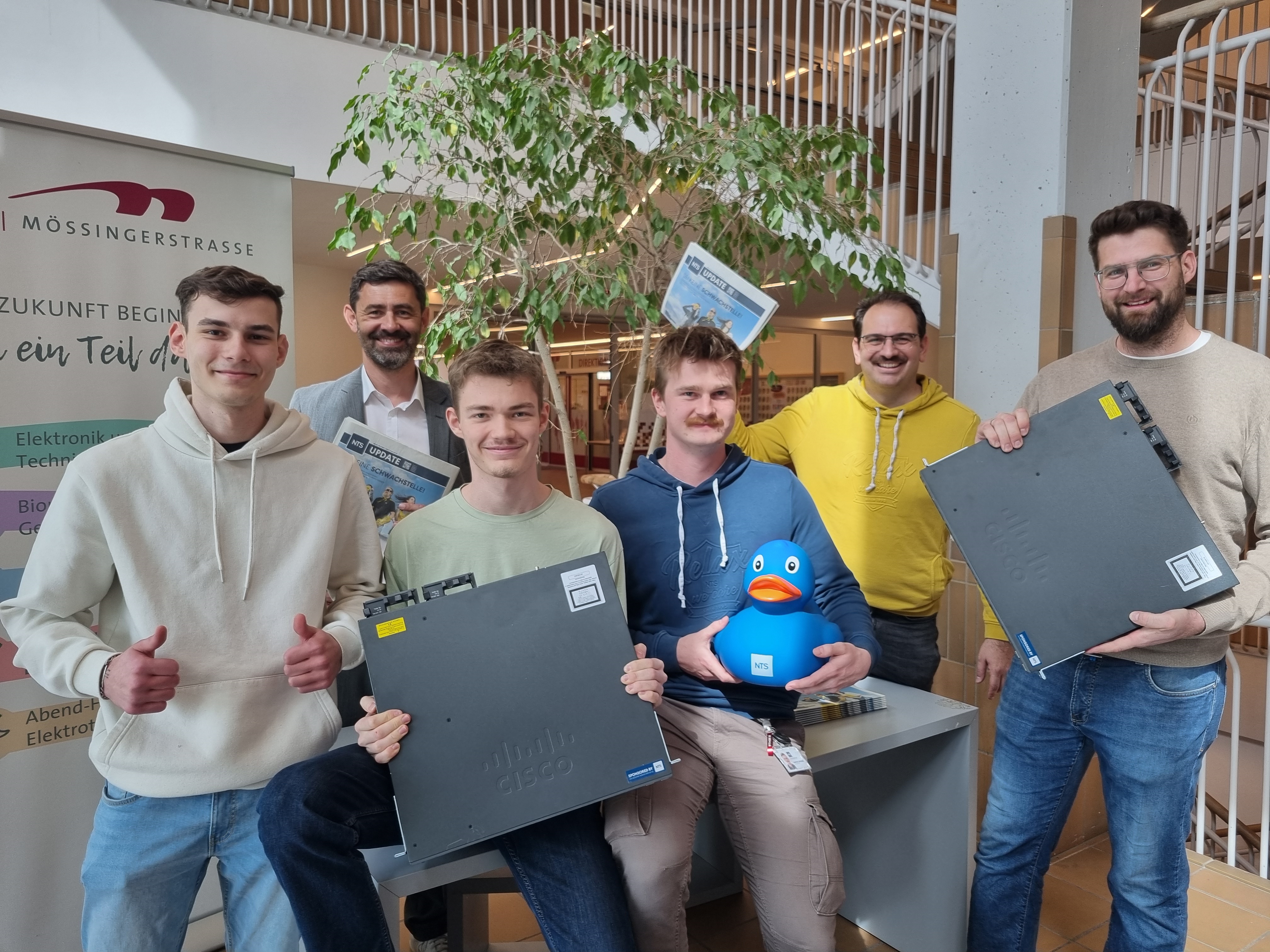

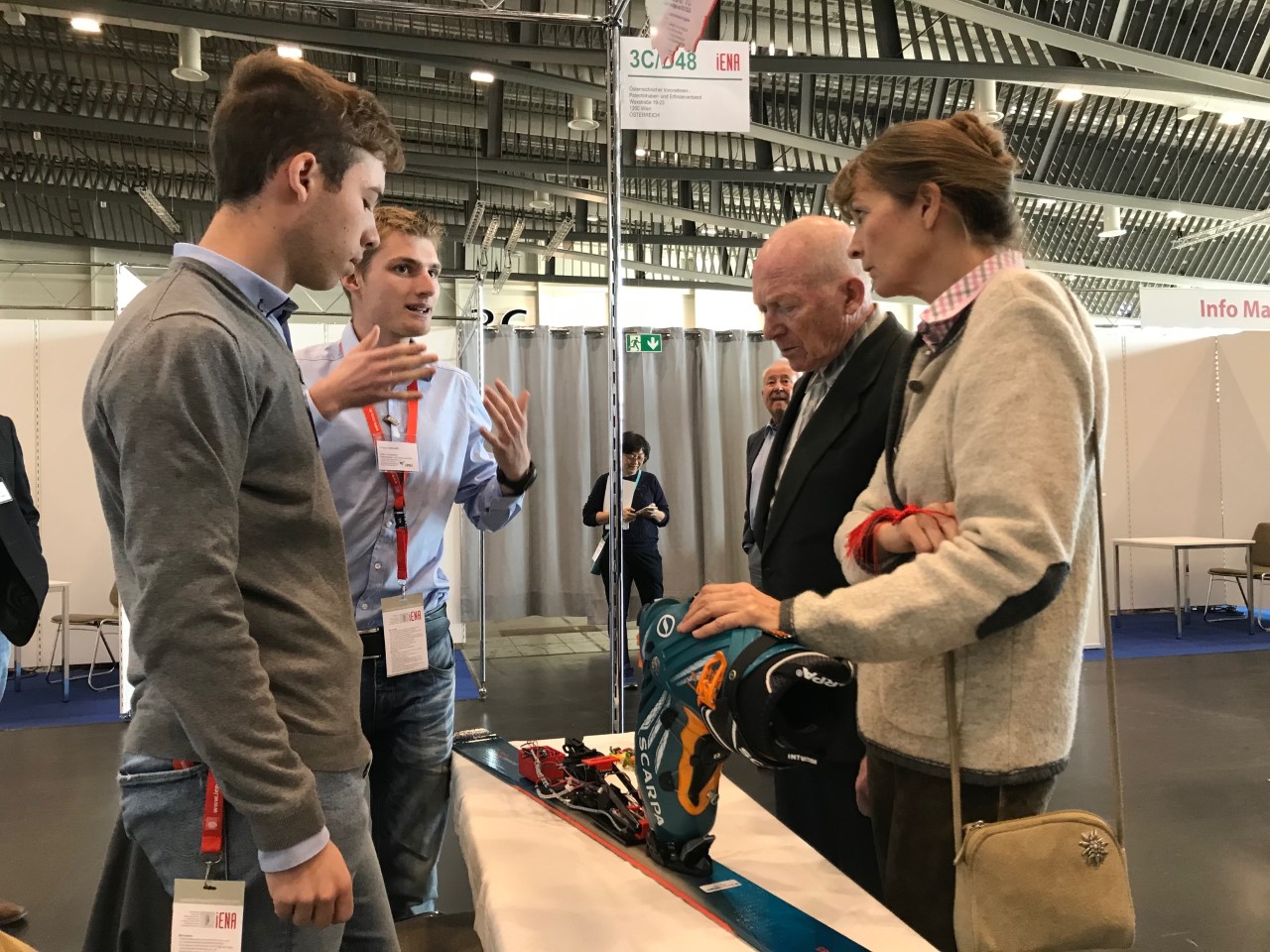

Die HTL Mössingerstraße war als einzige Schule Österreichs mit 3 Projekten vertreten. Das Projekt „Automatischer Schikantenschleifer“ der Schüler David Riedl, Michael Kotschnig und Johann Markus Wernig aus der 5AHET konnte den 1. Platz in der Kategorie Engineering II erreichen. Neben einer Siegesprämie von € 2.000,-- gewannen die Schüler auch eine Reise nach Brüssel.

Das Projekt „Automatischer Schikantenschleifer“ konnte aber auch am 26.04.2023 im 18. Maturawettbewerb der FH Kärnten aus mehr als 70 Projekteinreichungen aus 7 Bundesländern den 2. Platz in der Kategorie Engineering erringen. Auch hier war die HTL Mössingerstraße mit 3 Projekten vertreten. Das Projekt „smart DumbBell“ konnte in der Kategorie IT sogar den 1. Platz belegen.

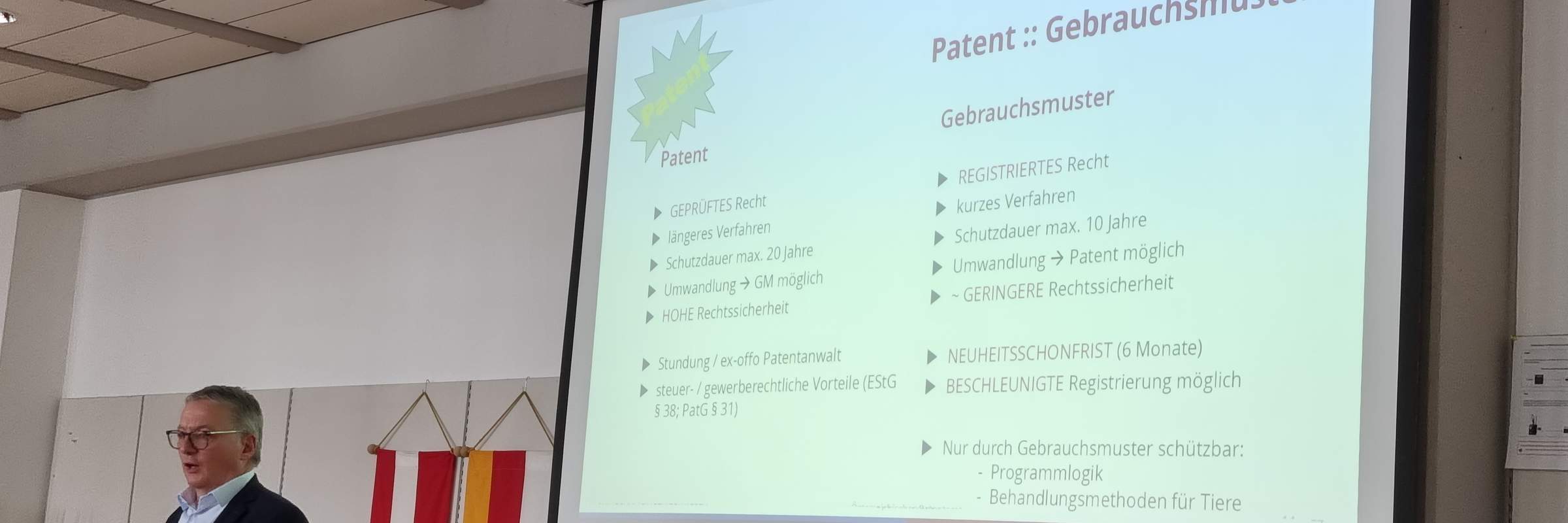

Aber auch beim BOSCH Innovationspreis ist das Team vom „Automatischen Schikantenschleifer“ unter den 5 besten Einreichungen Österreichs in der Kategorie Engineering. Ziel des Bosch Innovationspreises ist es, jährlich die besten Talente an Österreichs Höheren Technischen Lehranstalten (HTL) zu finden. Mit einem neuen Namen liegt der Fokus seit diesem Jahr mehr denn je auf Innovation. Bisher als „Technik fürs Leben-Preis“ bekannt, hat der größte unternehmensinitiierte HTL-Wettbewerb in den vergangenen 15 Jahren in Österreich zahlreiche junge Talente gefördert und bei ihrem Start ins Berufsleben unterstützt.

Die Prämierung der Projekte fand am 13.06.2023 in Wien statt.

Wie schon fast eine Tradition an der HTL Mössingerstraße, durften wir auch heuer wieder mit sogar drei Teams – als einzige HTL aus Kärnten – am…

mehr

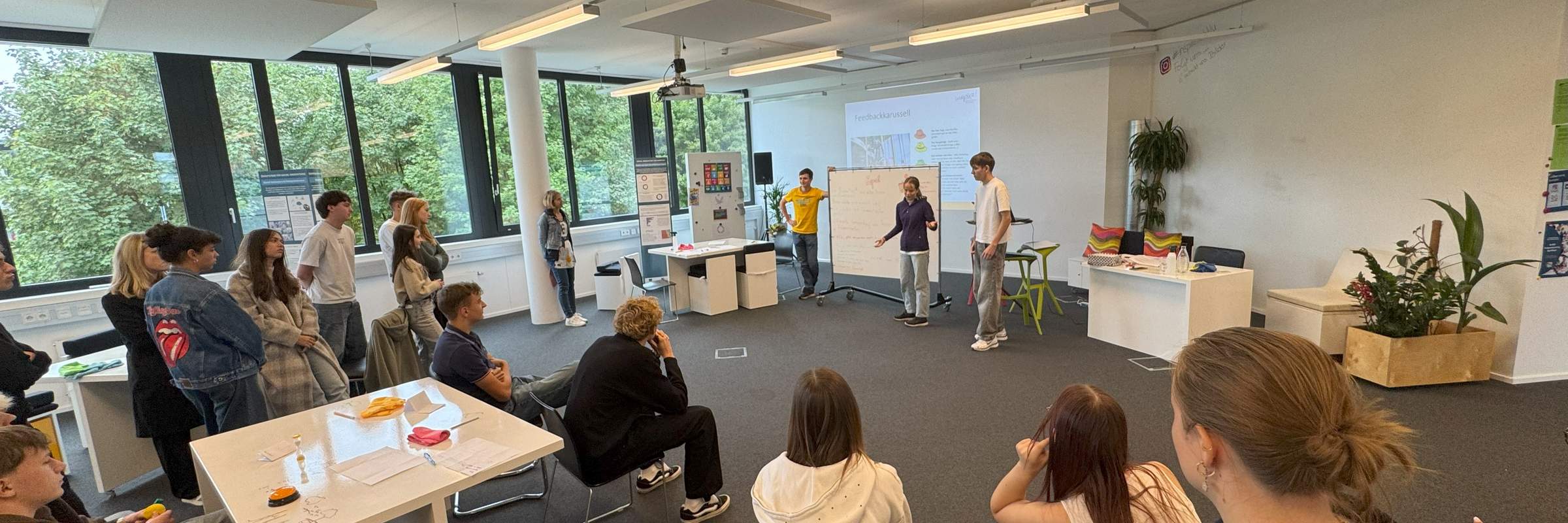

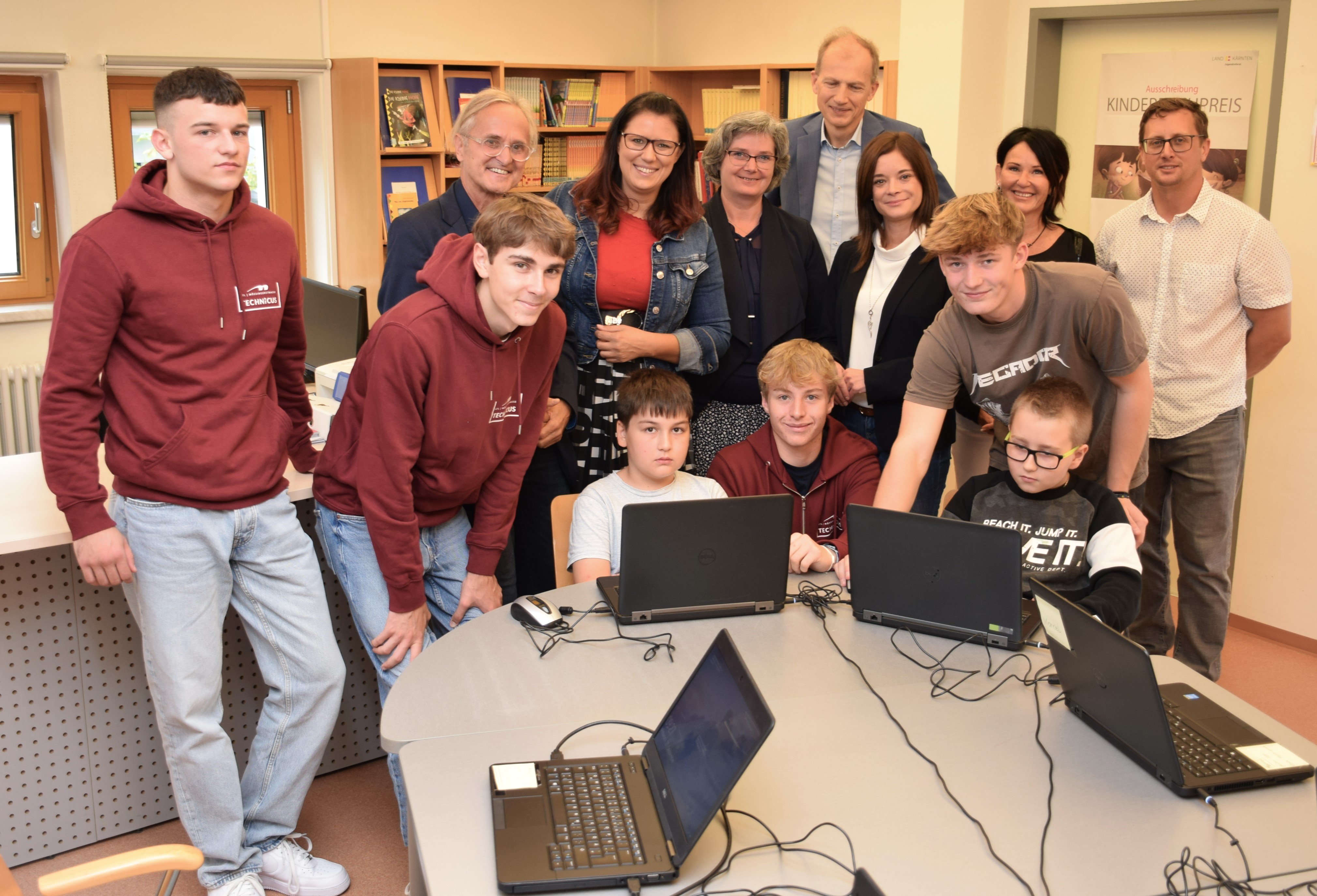

Wie bereits in den vergangenen Jahren konnte unsere Schule auch beim diesjährigen Ideenwettbewerb innovation@school wieder sehr erfolgreich…

mehr

Die Junior Company Kippe`s gewinnt den Bundeswettbewerb 2026 in Wien und qualifiziert sich für den Europawettbewerb in Riga!

mehr