Homepage

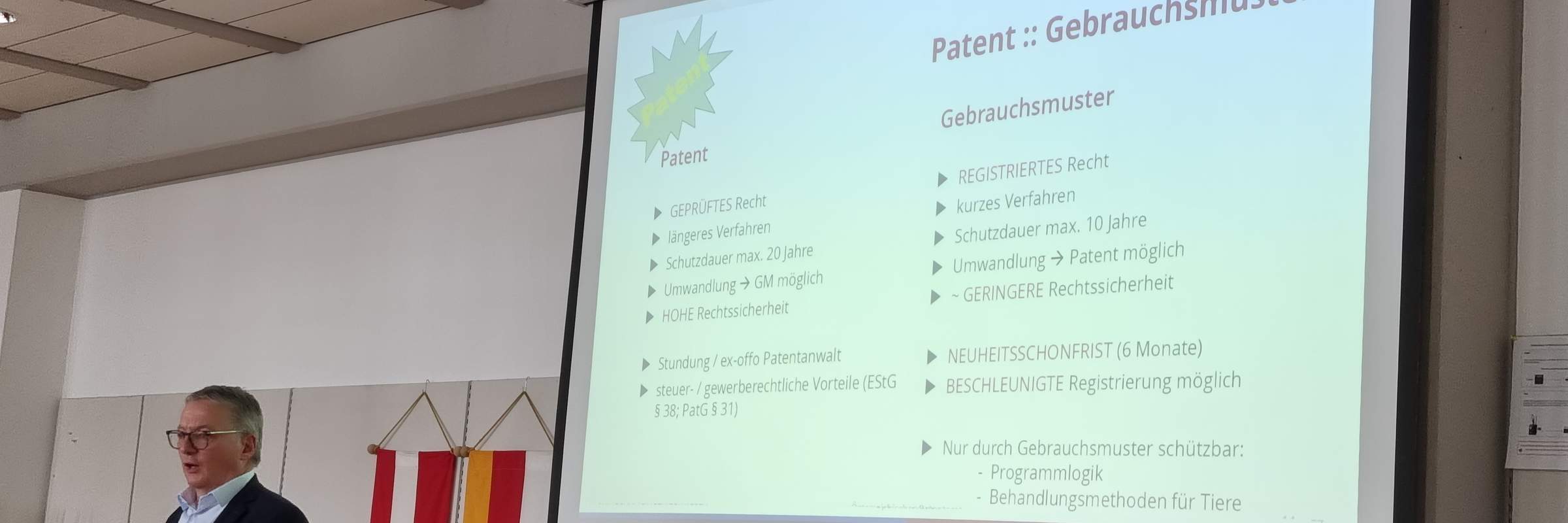

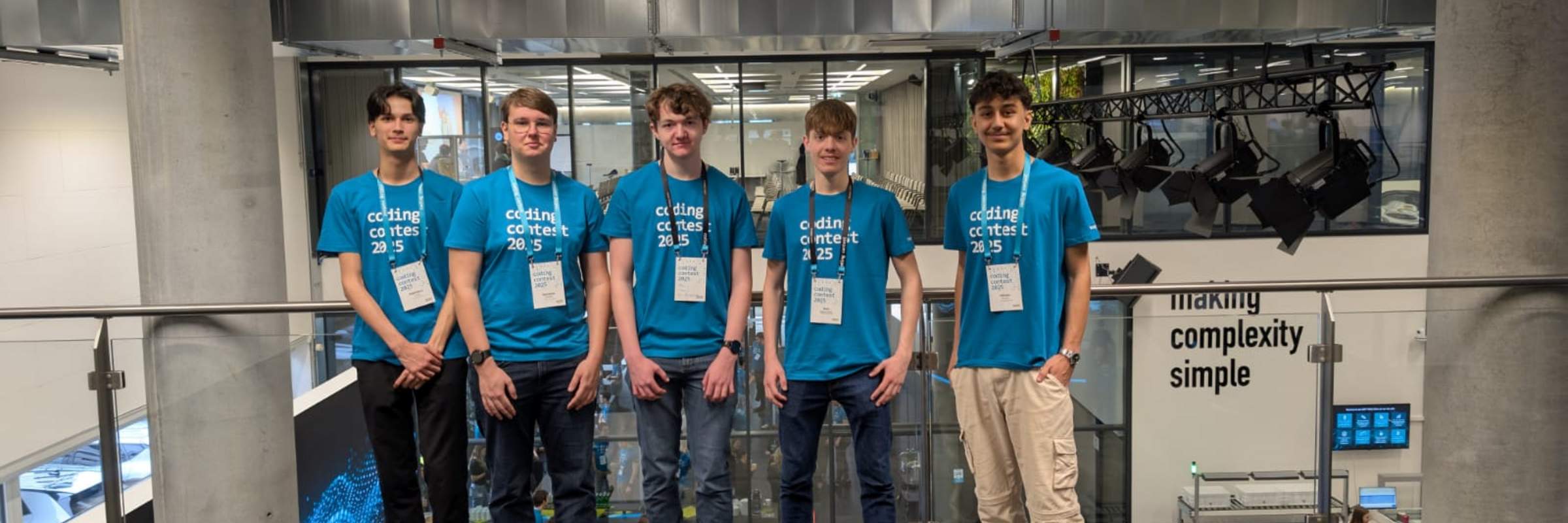

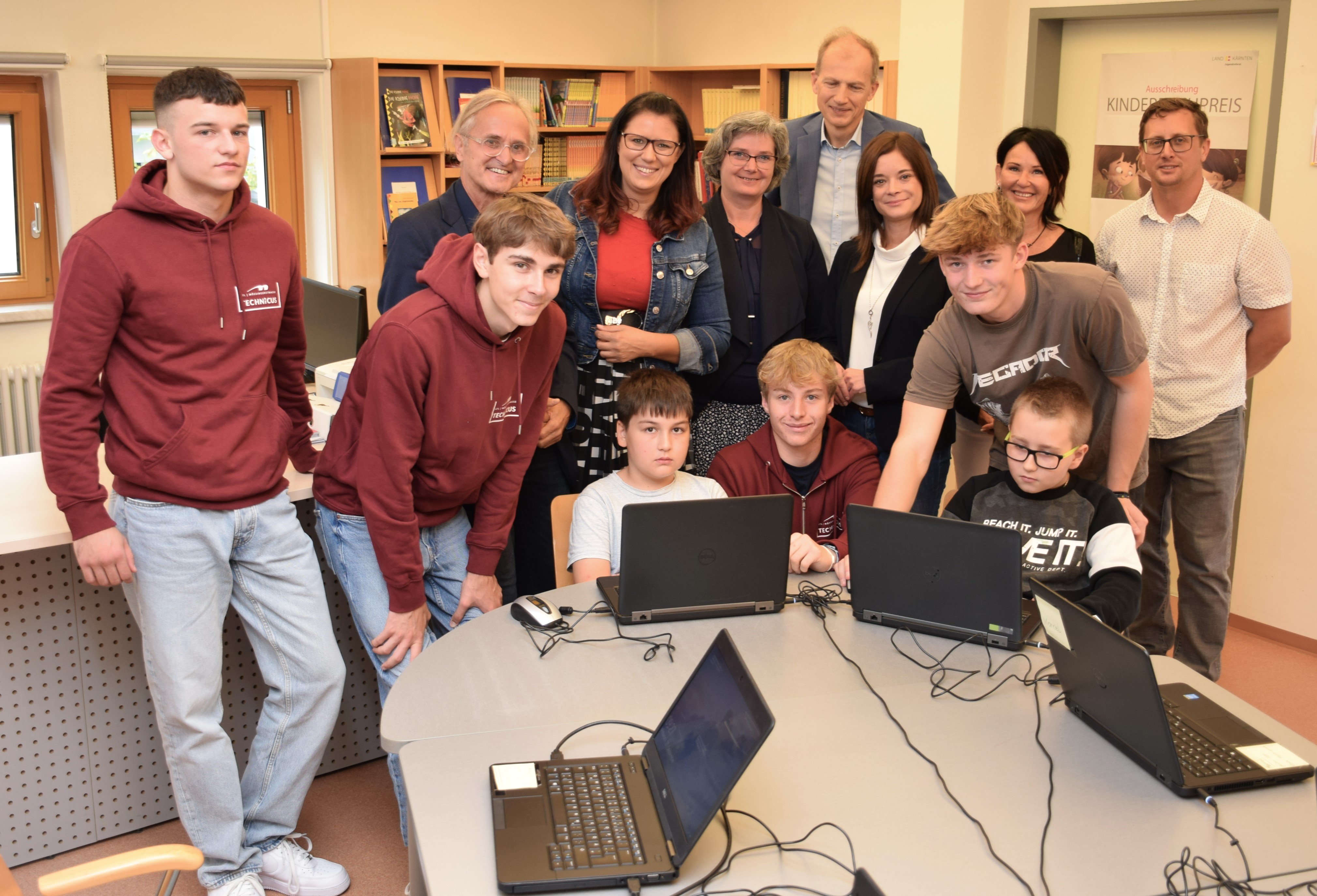

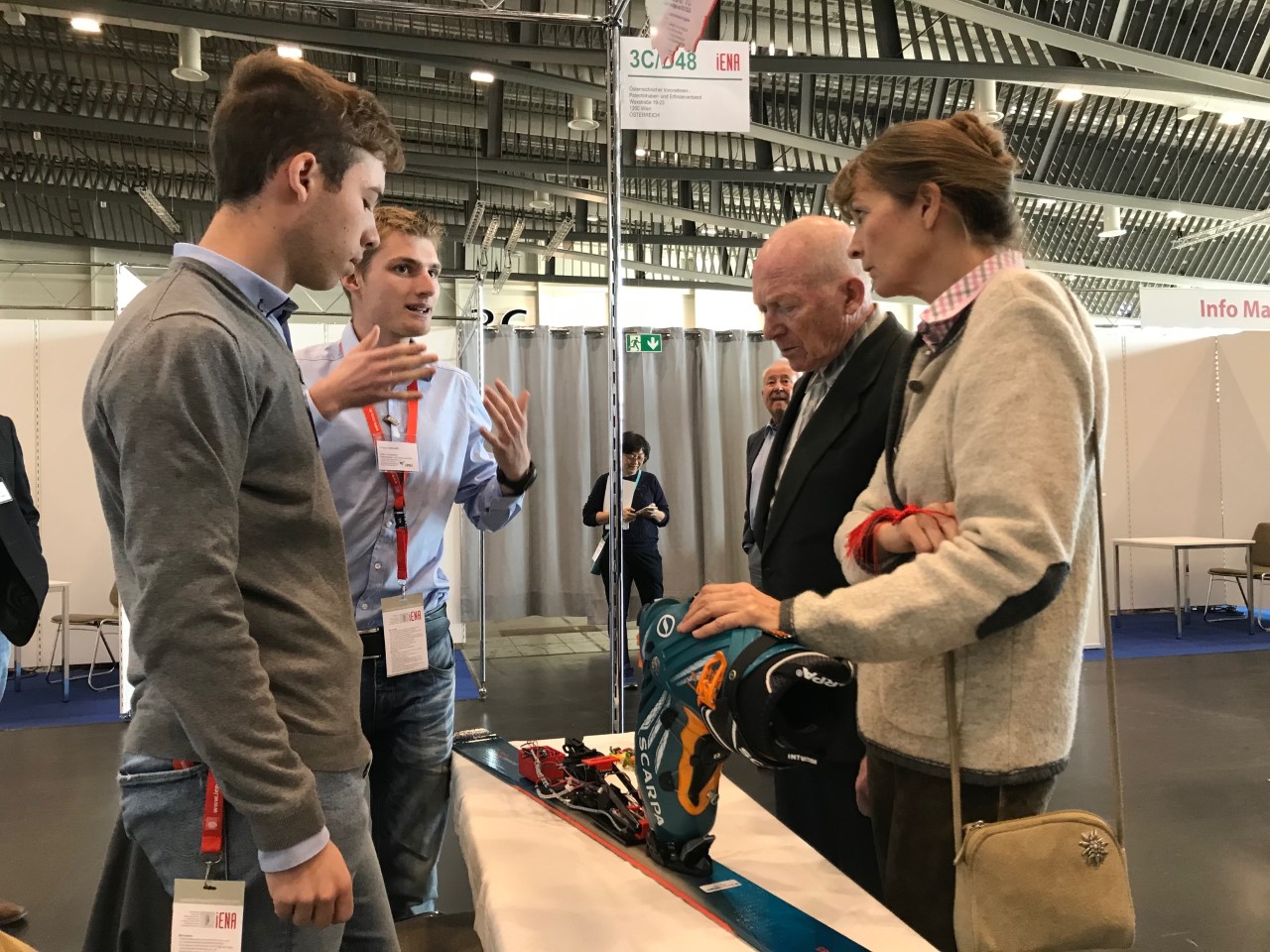

Wie bereits in den vergangenen Jahren konnte unsere Schule auch beim diesjährigen Ideenwettbewerb innovation@school wieder sehr erfolgreich…

mehr

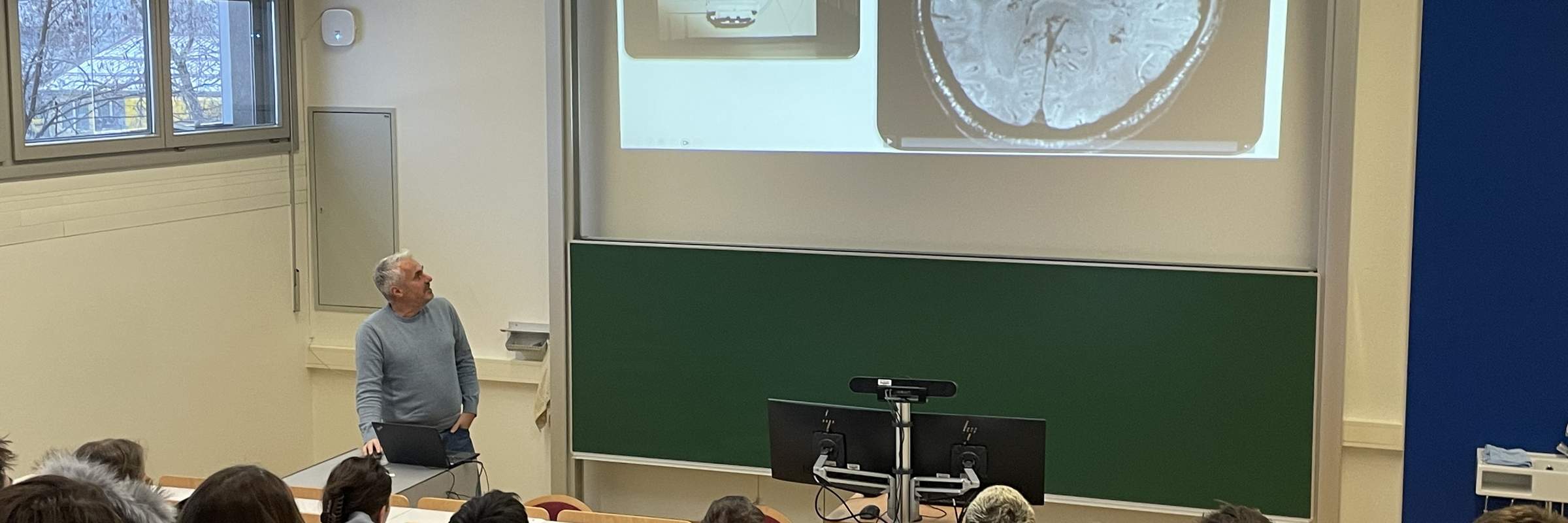

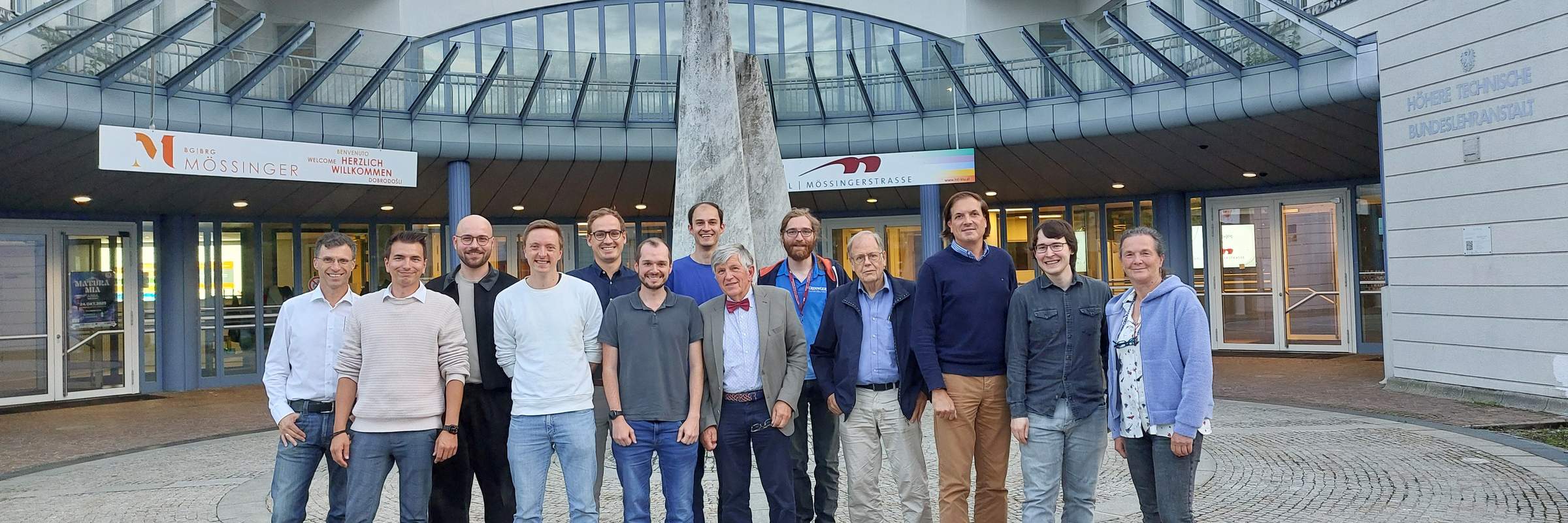

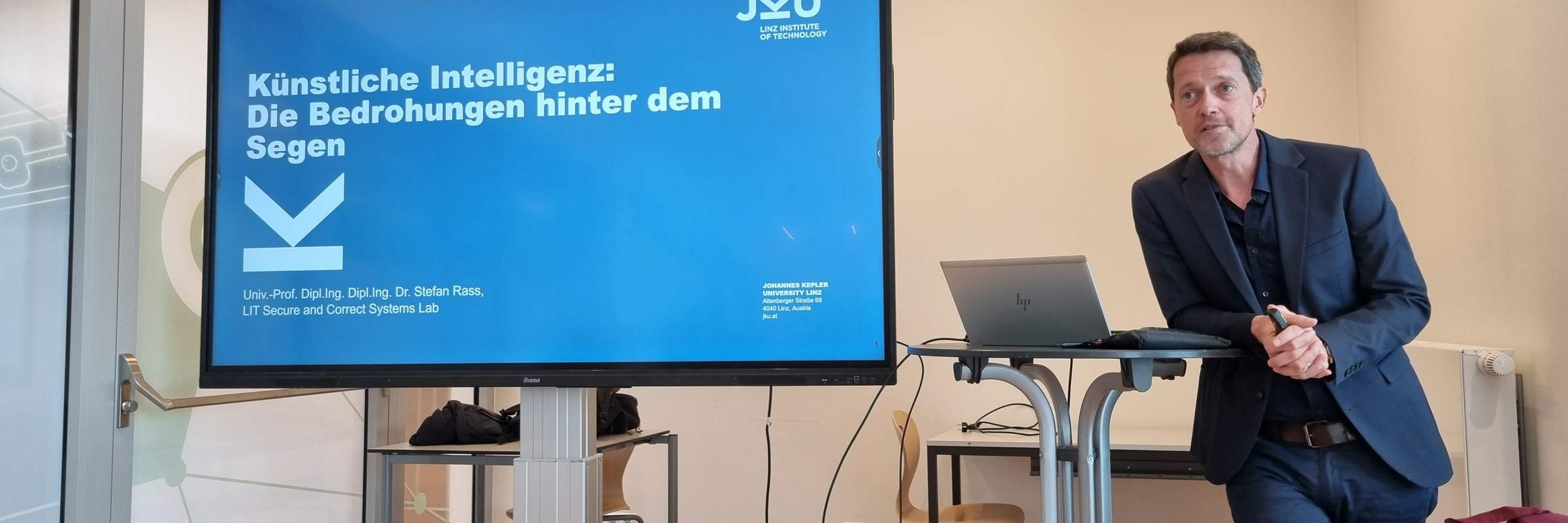

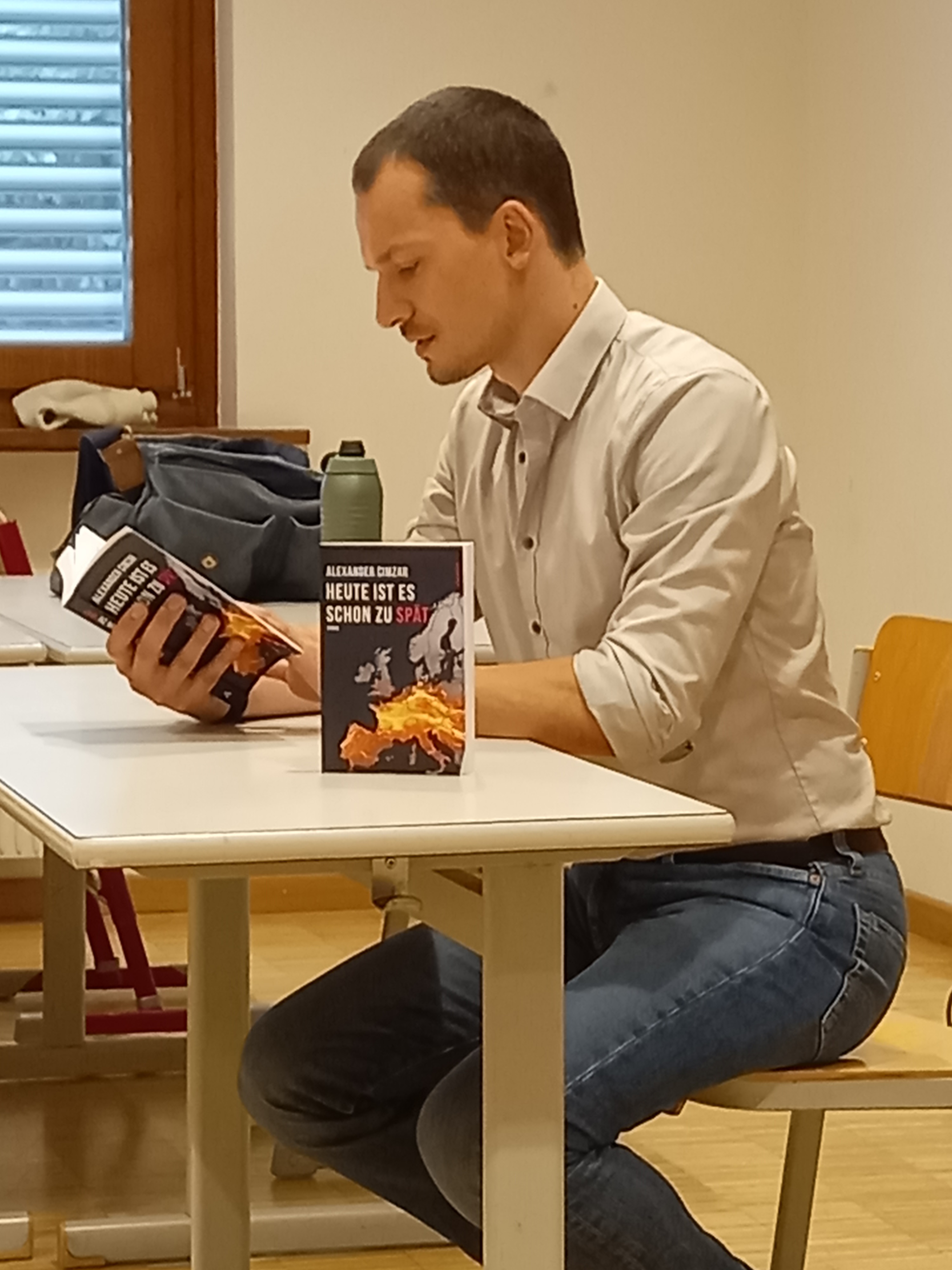

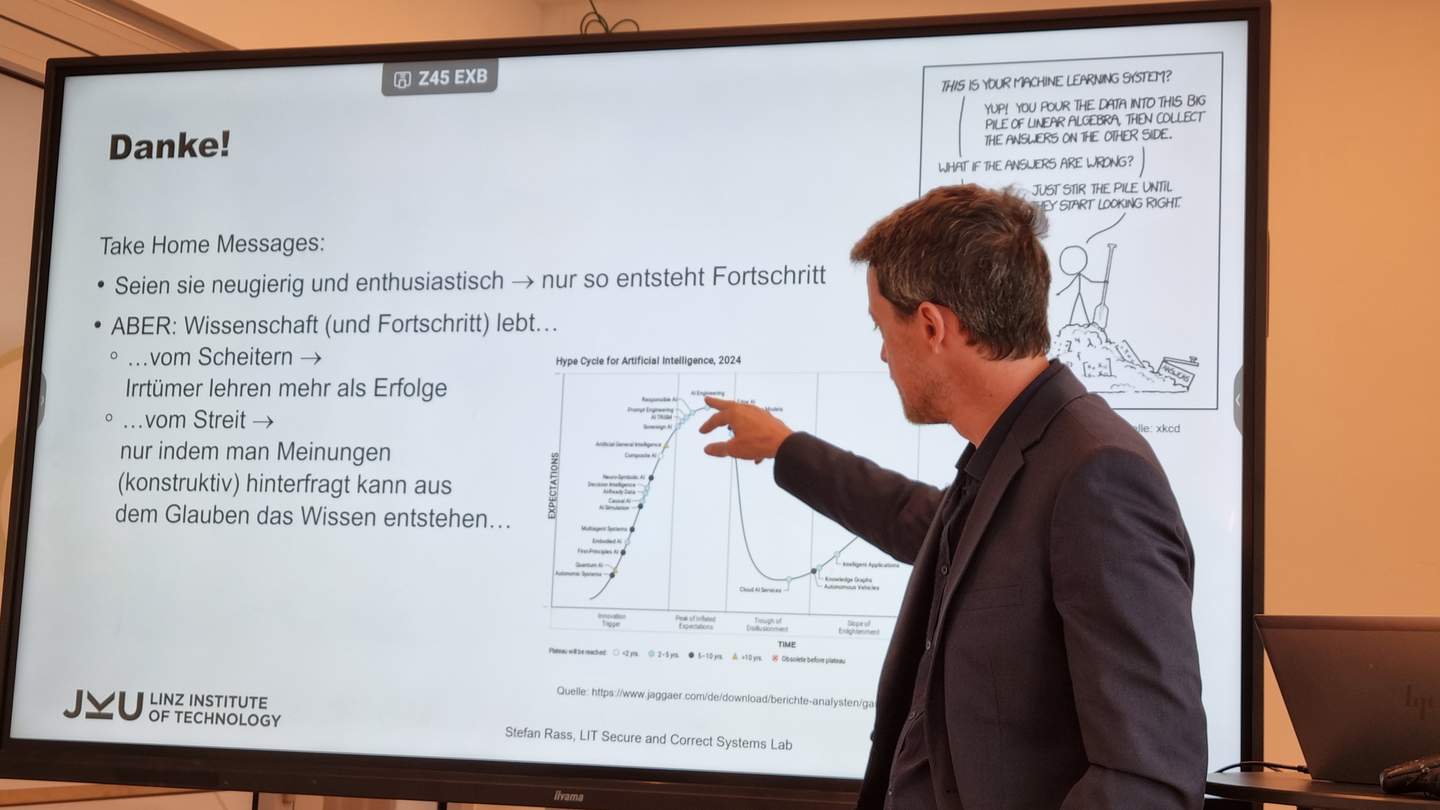

Er betonte die Probleme der Vertraulichkeit von Trainingsdaten und die Gefahr, durch Veränderung der Metrik von KI-Modellen „gewünschte“ Ergebnisse zu erzwingen. Diese könnten als DSGVO-konform und pseudo-objektiv dargestellt werden. Transparenz bei der Modellerstellung ist daher essenziell.

Ein weiteres Thema war die Schwierigkeit, Daten gezielt aus KI-Modellen zu löschen, um Biasing zu verhindern.

Large Language Models (LLM) wie ChatGPT bezeichnete er als „hochkomplexe Zufallsgeneratoren“, da ihre Antworten auf Wahrscheinlichkeiten beruhen. ChatGPT 3.0 wurde mit circa 230 Millionen Buchseitenäquivalenten (Überschlagsrechnung) trainiert, jedoch fehlt es an semantischem Verständnis und logischen Schlussfolgerungen.

Er warnte vor der Gefahr, dass LLMs degenerieren und kritische Foren wie Stack Overflow austrocknen könnten, was zu einem Verlust von Weltwissen führen würde („catastrophic forgetting“).

Seine Schlussfolgerung: Bleiben Sie kritisch, hinterfragen Sie Antworten und bleiben Sie neugierig und enthusiastisch. Nur so entsteht Fortschritt.

AV DI Harald Grünanger

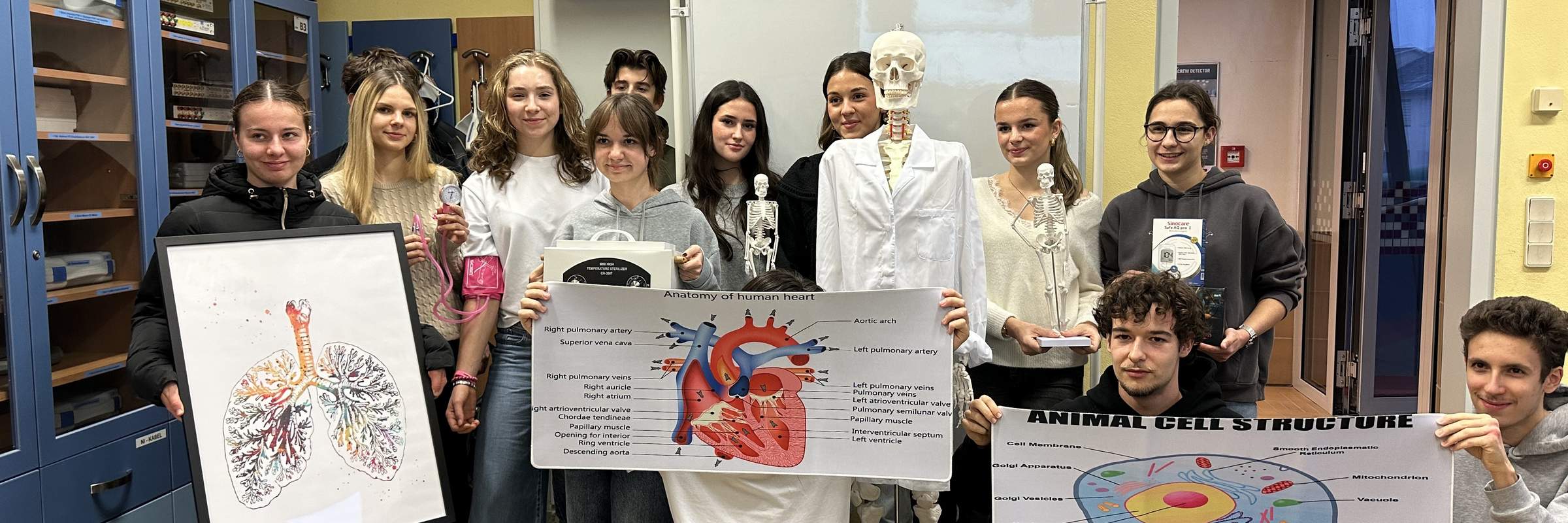

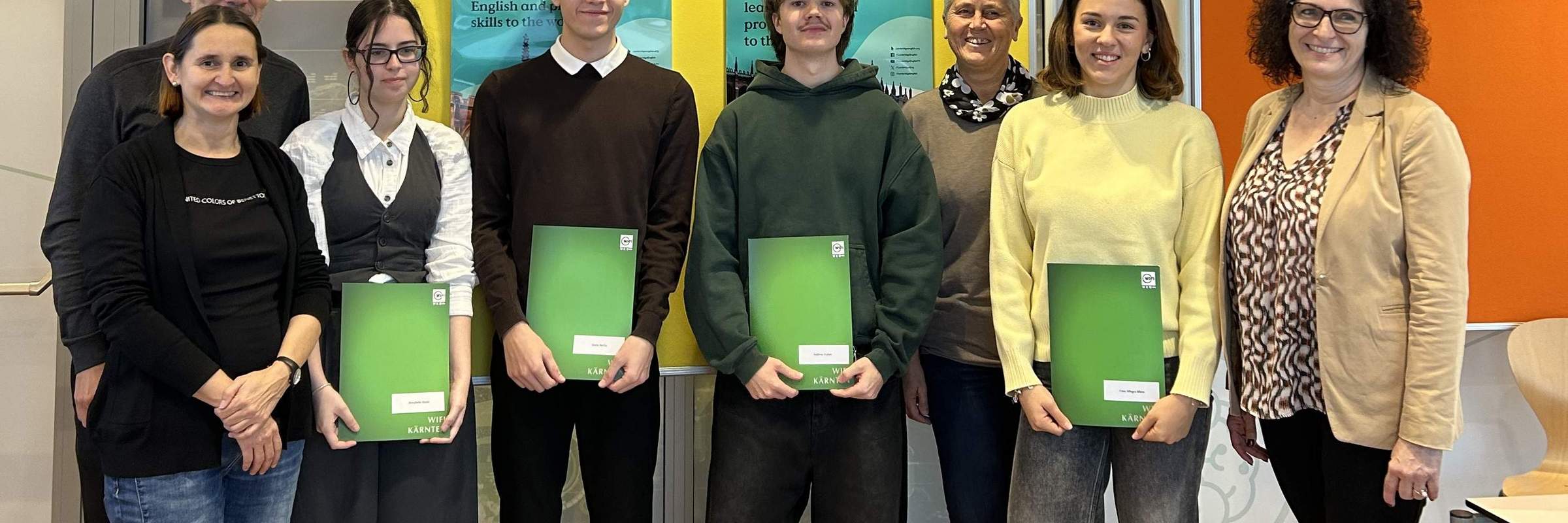

Wie bereits in den vergangenen Jahren konnte unsere Schule auch beim diesjährigen Ideenwettbewerb innovation@school wieder sehr erfolgreich…

mehr

Die Junior Company Kippe`s gewinnt den Bundeswettbewerb 2026 in Wien und qualifiziert sich für den Europawettbewerb in Riga!

mehr

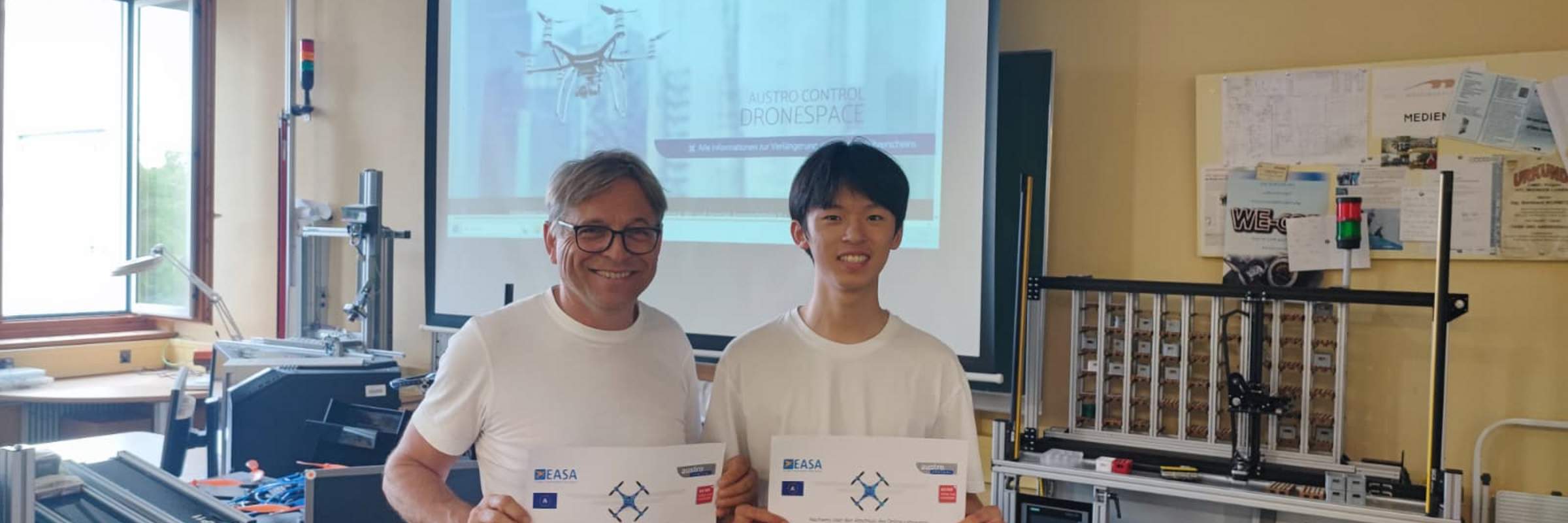

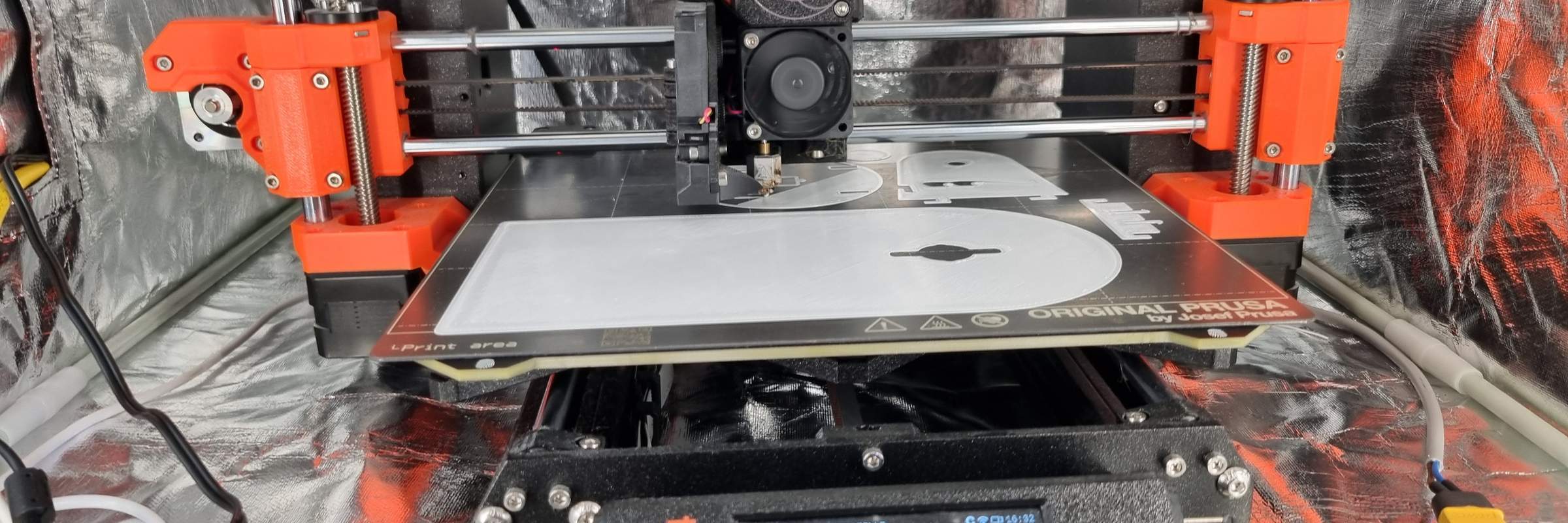

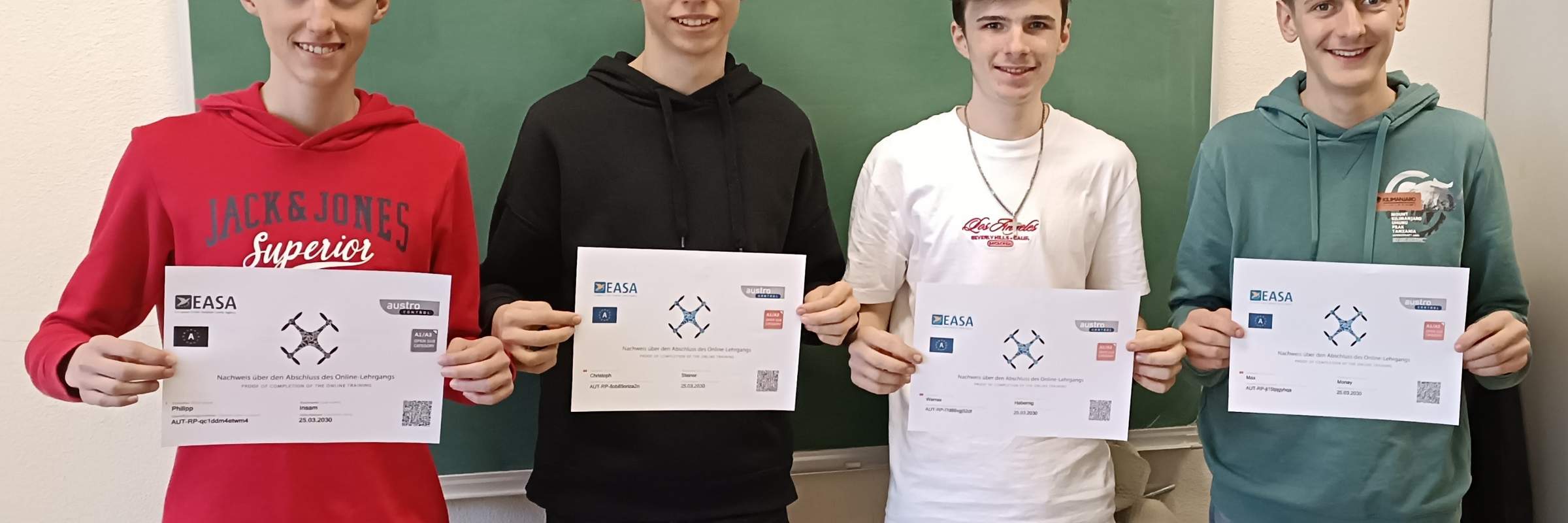

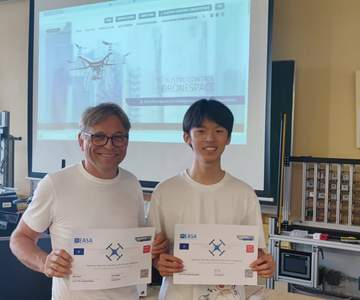

Heute haben zwei Teilnehmer des Freigegenstandes „3D-Druckerbau und RC-Modellflug“ den österreichischen Drohnenführerschein erfolgreich bestanden!

mehr